Quali sono le differenze tra i diversi livelli di macchine pensanti? E poi, riusciranno a diventare più intelligenti di noi?

Si fa presto a dire intelligenza artificiale generativa. O generale. Alle volte, però, confondiamo termini che non sono sinonimi. Intelligenza artificiale generale e ristretta vogliono dire due cose diverse. E intelligenza generativa ancora un’altra. Sono differenze che contano anche da un punto di vista normativo. Vale la pena, allora, fare un po’ di chiarezza.

Intanto, possiamo parlare di “intelligenze artificiali“, al plurale, perché esistono tipi e modi diversi per rendere un computer capace di fare dei calcoli che simulano in qualche modo l’intelligenza umana. Ancora, non dobbiamo mai dimenticare che l’intelligenza artificiale è comunque una branca dell’informatica, e non una scienza a se stante.

In ogni caso, è dimostrato scientificamente che delle macchine intelligenti possa esistere. Alan Turing, in un lavoro pubblicato nel 1950, Computing Machinery and Intelligence, si è chiesto se una macchina possa pensare. E, dato che “pensare” è un termine alquanto ambiguo e difficile da definire, ha riformulato la domanda: può una macchina fare quello che noi, come soggetti pensanti, facciamo? La dimostrazione matematica di Turing dice che sì, è possibile. Ma a quell’epoca (e in parte ancora oggi) non era possibile arrivare a quel risultato concretamente.

Le intelligenze artificiali

Per questo motivo Turing ha formulato un esperimento per riconoscere una intelligenza artificialecapace di pensare come una persona. Si chiama The imitation game, il gioco dell’imitazione, ma viene generalmente chiamato test di Turing. L’idea è che una macchina capace di passare quel test è in grado di ingannare un essere umano, e quindi viene così dimostrato che è “come se fosse” capace di pensare.

Il problema è che molte intelligenze artificiali (o “sistemi esperti”, come sono anche stati chiamati) erano in grado di fare sorprendentemente bene una cosa, ma non tutte le altre. Potevano agire in un ambito “ristretto”, quindi, rispetto all’obiettivo di una intelligenza artificiale “generale”, ovverosia capace di fare tutto quello che fa un essere umano e, potenzialmente, meglio.

Agi: Intelligenza Artificiale Generale

L’intelligenza artificiale generale (o Agi, dall’acronimo inglese), è dunque una AI capace di fare molte cose diverse. Non è limitata agli aspetti “generativi” di alcune delle intelligenze artificiali ristrette (quelle capaci di fare una sola cosa: creare un disegno ma non preparare un caffè o rispondere alla domanda: Che ore sono?), ma può fare tutto, compreso generalizzare i problemi, derivando dei principi dai problemi concreti.

L’Agi, insomma, deve poter comprendere, apprendere e applicare l’intelligenza in un’ampia gamma di compiti, allo stesso modo in cui lo farebbe un essere umano. E soprattutto, deve essere capace di trasferire la conoscenza da un campo all’altro, imparando a fare anche cose per cui non è stata programmata o addestrata. Deve essere anche cosciente? In realtà, per uno scienziato la domanda non ha molto senso, perché intelligenza e coscienza sono due concetti diversi che appartengono a due piani separati e non comparabili.

Generative AI, l'intelligenza artificiale generativa

Le intelligenze artificiali generative, invece, sono state create per svolgere specifici compiti. Da questo punto di vista, se le paragoniamo a una Agi, sono AI “ristrette”. A differenza delle Agi, che non sono vincolate necessariamente a una specifica tecnologia o insieme di algoritmi, le intelligence artificiali generative che abbiamo oggi riescono a raggiungere i loro risultati perché si basano su modelli di reti generative avversarie (le Gan) e i modelli di trasformazione. Possono generare testo, immagini, musica o altri tipi di dati (anche tipi di cose digitali che gli esseri umani non sono in grado di capire, tantomeno generare) ma la cosa importante è che il loro prodotto non è una copia esatta, anche se mantiene tuttavia una forte coerenza con le altre creazioni di quel tipo.

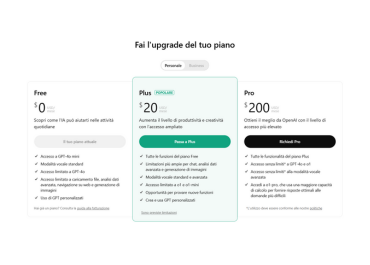

Oggi ci sono ChatGPT, Bard, Llama e decine di altri esempi. Ma hanno tutti un antenato comune. Infatti, il primo esempio di AI generativa (programmata con altri tipi di algoritmi) risale al 1966: è il chatbot Eliza scritto dal professore del Mit di Boston Joseph Weizenbaum. Con poche centinaia di righe di codice i chatbot di Weizenbaum riescono a raggiungere risultati sorprendenti. Lo scienziato crea diverse versioni di Eliza con delle “personalità” diverse, basate su dei “copioni”. Quello che ha molto successo è Doctor, uno psicoterapeuta cibernetico della scuola “non direttiva” di Carl Rogers (un vero psicoterapeuta). Nella scuola di Rogers il terapeuta “gira” le frasi dette dal paziente in forma interrogativa e gliele ripete. Questo approccio semplifica molto il lavoro del chatbot, che sembra particolarmente realistico proprio perché deve in realtà fare molto poco.

Nel corso del tempo le AI generative diventano sempre più potenti. Oggi una AI generativa che crea un disegno ad acquerello lo fa sulla base di un prompt che definisce un soggetto, ed è capace di “inventarsi” il modo di mettere assieme l’opera, pescando nella logica e negli esempi che fanno parte del suo addestramento. Non produce una copia esatta, bensì qualcosa “alla maniera” di un acquerello definito dal prompt iniziale. Tuttavia, questo pone vari problemi: dalla effettiva originalità dell’opera prodotta alla titolarità del diritto d’autore, sino all’eventuale plagio o uso di materiale coperto da copyright utilizzato nell’addestramento.

Gli altri tipi di intelligenza artificiale

È possibile che una intelligenza artificiale generale superi la capacità di un essere umano? Diventi cioè “super”? In teoria, niente lo impedisce: come per i processori o per il software, le versioni successive alla prima, cioè la due, la tre, la quattro punto zero e successive, sono sempre possibili. Non ci sono limiti perché questo avvenga, a differenza della scala e velocità evolutiva del nostro cervello. Nel caso l’AI superi la nostra capacità generale di “pensare”, si parla di Super-Agi, cioè di una intelligenza artificiale generale con capacità cognitive superiori a quelle degli esseri umani.

Quindi, dopo l’intelligenza artificiale ristretta (che gli anglosassoni chiamano Ani, dall’acronimo Artificial Narrow intelligence) e dopo quella generale (Agi), nella teoria informatica c’è spazio anche per l’Asi, Artificial Super Intelligence, l’AI più “intelligence” degli esseri umani.

Se l’Agi ancora non è stata raggiunta, l’Asi è completamente di là da venire. Tuttavia, dal momento che l’accelerazione nello sviluppo dell’intelligenza artificiale non è lineare, e che potrebbe venir ulteriormente potenziato dall’uso della stessa AI per progettare nuovi metodi e algoritmi di intelligenza artificiale, la distanza tra l’Agi e l’Asi potrebbe essere molto più breve di quella che ci separa dall’Agi stessa.